Het Europees neppparlement neemt morgen een volgende poging om het open internet definitief uit te roeien: en wordt dan gestemd over de "Terrorist Content Regulation"-richtlijn. Het restantje van de vrijheid van meningsuiting wordt - als het aan devolkslobbyvertegenwoordigers ligt - vakkundig opgeruimd. Iets om bij de komende EU-verkiezingen te onthouden!

De afgelopen maanden hebben we op de site herhaaldelijk gewaarschuwd

dat als je je al zorgen maakt over de nieuwe EU-auteursrechtrichtlijn

- die gisteren is goedgekeurd -, je absoluut doodsbang moet zijn over

de EU-verordening inzake terrorismecontent, een maatregel die onder

zeer weinig aandacht van de mainstream media wordt doorgevoerd.

We hebben de vele, vele problemen met de "Terrorist Content

Regulation" beschreven, te beginnen met de eis dat elke site (zelfs

een eenpersoonsblog ergens buiten de EU) binnen een uur na

kennisgeving door een "deskundige autoriteit" een zwak omschreven

inhoud moet verwijderen. Maar ook voor andere aspecten, zoals

verplichte inhoudfilters, zijn de onbenullen in Brussel wel te porren.

Toen de burgerrechtencommissie van het Europees nepparlement, LIBE,

het voorstel vorige week naar voren bracht, heeft het enkele van de

slechtste aspecten van de wet eruit gehaald, maar heeft het de

inhoudverwijderingsverplichting van 1 uur er in gelaten. En de

grootste politieke groep in het EU-nepparlement, de EVP, heeft al

amendementen ingediend om alle andere slechte dingen in het voorstel

terug te brengen.

Het EU-nepparlement stemt morgen over de verordening

terrorismebestrijding en dat zal vermoedelijk uitdraaien op het

terugbrengen van de vreselijke dingen uit het voorstel. Hopelijk komen

er ook amendementen om de belachelijke en onmogelijke

één-uurs-verwijdering uit het voorstel te slopen (maar dat zal wel

niet).

Zoals gezegd staat het onredelijke voorstel van de Commissie (dat

illegale terroristische inhoud - wat dat ook moge zijn - binnen een

uur moet worden verwijderd) nog in het standaardontwerp van de

LIBE-commissie (zie artikel 4). De enige uitzondering op deze regel is

dat een website-eigenaar voor de allereerste keer een

verwijderingsbevel ontvangt van een "bevoegde" autoriteit. In dat

geval krijgen ze 12 uur om vertrouwd te raken met de procedure en de

van toepassing zijnde deadlines. Naderhand, ongeacht de grootte van

het platform of de middelen, moeten ze binnen eeéén uur reageren om

hardere straffen te voorkomen. Deze boetes kunnen oplopen tot 4% van

de omzet van een platform in geval van aanhoudende inbreuken (zie

artikel 18).

Een deadline van een uur voor de verwijdering van content is volledig

onwerkbaar voor platforms die worden gerund door individuen of kleine

providers, die niet in staat zijn personeel aan te nemen dat is belast

met de afhandeling van mogelijke verwijderingsbevelen 24 uur per dag,

7 dagen per week.

Van een privé-eigenaar van de website mag niet verwacht worden dat hij

's nachts en tijdens het weekend bereikbaar blijft, in het

onwaarschijnlijke geval dat iemand terroristisch materiaal uploadt.

Hun enige realistische optie die beschikbaar is, is automatisering van

verwijderingen: terrorismefilters via de achterdeur. Voor

privé-personen een niet te betalen mogelijkheid. Deze maatregel

bevoordeelt dus vooral de grote spelers op het internet, en drukt de

kleinere, concurrerende spelers eruit.

Het blind verwijderen of blokkeren van gemarkeerde content zonder

beoordeling leidt onherroepelijk tot het verwijderen van legale

uploads, zoals een nieuwsbericht over terrorisme met beelden uit een

oorlogsgebied, dat in een andere context inderdaad illegaal kan zijn.

Vandaag de dag zijn er genoeg voorbeelden van overijverige

administratieve autoriteiten die volmaakt juridisch materiaal markeren

als inhoud van terroristen. Opgemerkt moet worden dat, anders dan de

titel van die post suggereert, deze kennisgevingen niet afkomstig

waren van een EU-agentschap, maar van een Franse nationale autoriteit.

Daarom is het noodzakelijk dat websites van elke omvang de nodige tijd

hebben om rapporten te beoordelen - en dient de bureaucratisch

maatregel te worden geschrapt. Het best is die in de kliko te gooien,

samen met het hele wetsvoorstel, en de politici die ervóór hebben

gestemd en nog gaan stemmen.

Gezien wat we al hebben meegemaakt met de auteursrechtrichtlijn, zal

de kans groot zijn dat het Europees nepparlement een gruwelijke versie

van dit wetsvoorstel zal goedkeuren, waardoor het voor een kleinere

website onmogelijk wordt om effectief te werken binnen de EU zonder

geconfronteerd te worden met een enorme mate van aansprakelijkheid.

oor een site als die van ons zouden we onder sommige van deze

voorstellen letterlijk iemand moeten inhuren om 24 uur per dag op

afroep beschikbaar te zijn om content te verwijderen. Je kunt je

overigens afvragen in wat voor wereld we leven dat eigenaars van

websites hun oren moeten laten hangen aan een willekeurig persoon in

de EU die belast is met het natrekken van inhoud en de opdracht geeft

het te verwijderen als de aard ervan hem of haar niet aanstaat?

Inderdaad, in een dictatoriale wereld (die de Europese Unie heet).

Overigens hebben de leden van het Europees nepparlement blind

vertrouwen in Kunstmatige Intelligentie, als we althans afgaan op wat

ze hier allemaal in elkaar geflanst hebben. Dat dat heel raar kan

uitpakken schreven we

vijf dagen geleden, waar het

Internet Archief te horen kreeg dat zij enorm veel terroristisch

materiaal van haar site diende te verwijderen (onder andere het

Project Gutenberg en de Smithsonian Bibliotheken.

In de voortdurende morele paniek over algoritmen voor sociale

media en wat zij aanbevelen, zijn er verschillende suggesties over hoe

bedrijven "kunnen verbeteren" wat ze doen - en velen van hen stellen

voor te vertrouwen op nieuwere, betere algoritmen. Het is de hardere

"nerd" aanpak.

Mark Zuckerberg zelf heeft vorig jaar herhaaldelijk gesuggereerd dat

investeren in Kunstmatige Intelligentie een grote rol zou spelen in het

omgaan met vragen over inhoud-beheer. Dit is altijd een beetje gek

geweest, en we kunnen gemakkelijk demonstreren hoe gek deze gedachte is.

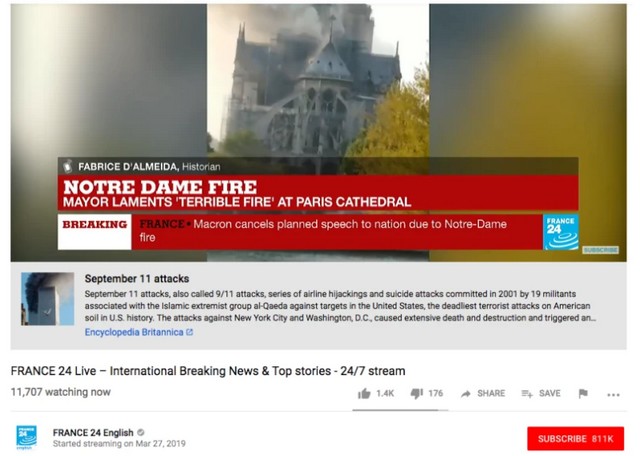

Hiertoe kijken we naar de tragische gebeurtenis, gisteren, met de Notre

Dame in Parijs. Hierbij leek YouTube's mooie nieuwe "feitencontrolerende

Kunstmatige Intelligentie" te denken dat meerdere video's van de brand

eigenlijk verwezen naar de aanslagen van 11 september 2001 in de VS, en

YouTube koppelde het nieuws vervolgens aan een pagina op Encyclopedia

Britannica met meer informatie over de aanslagen:

Deze verwijzingen duurden niet lang, maar op zijn minst zou het een

herinnering moeten zijn dat de verwachting dat Kunstmatige Intelligentie

op magische wijze feitjes in realtime controleert (op zijn minst) lang,

ver weg is en in het ergste geval: een bijna onmogelijk verzoek.

Hierdoor komen YouTube en anderen in een onmogelijke positie te staan.

Nog maar een paar weken geleden schreeuwden mensen moord en brand dat

YouTube en Facebook (kort) video's van de aanval in Christchurch

toestonden op hun platforms - en eisten ze dat de platforms "iets doen"

als reactie.

Het hebben van een tool dat op zijn minst een soort context biedt, of

zelfs aangeeft wat onzin is (wanneer mensen beginnen met het posten van

onzin) dan zou dat een goed idee kunnen zijn. Maar het vereist een

niveau van verfijning en nauwkeurigheid dat momenteel in grote mate

ontbreekt.

Maar een juistere reactie (van politici, en eigenlijk mensen in het

algemeen) op dit alles zou zijn om toe te geven dat mensen niet perfect

zijn, dat sociale media soms alle aspecten van de mensheid weerspiegelen,

en dat soms slechte dingen ook online komen te staan, maar dat lijkt

voor een groot aantal mensen niet acceptabel. Maar toch zal iedereen

moeten accepteren dat Kunstmatige Intelligentie dit soort dingen

belachelijk verkeerd zal aanpakken - en van Brussel krijgen de platforms

één uur de tijd dat te corrigeren.